|

本次为补丁,请打在1.6.2完整包上!

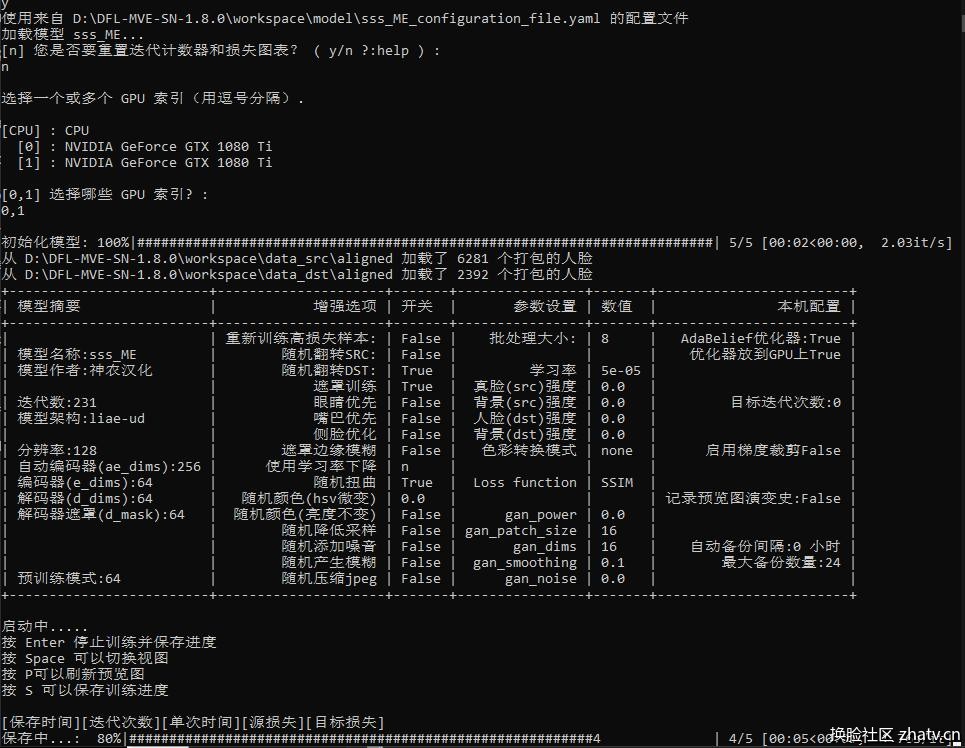

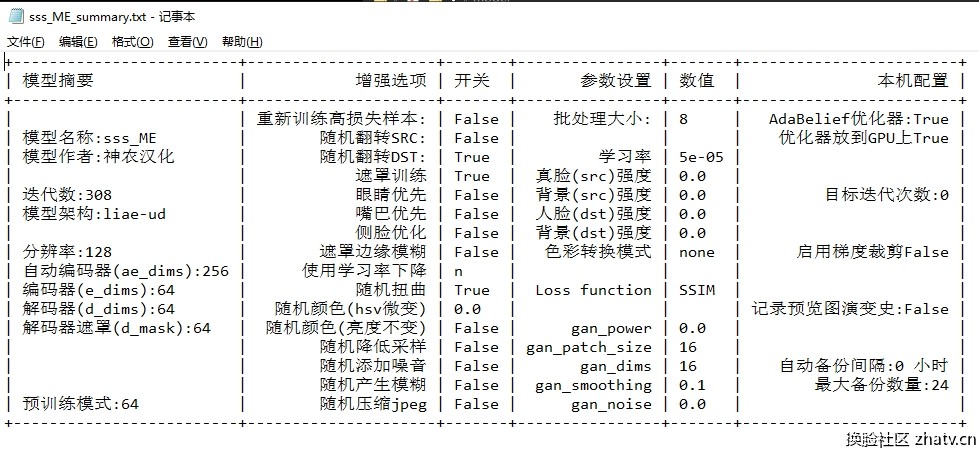

2024年3月16日: v1.8.0版本: 1.全面重构summary的显示格式,包括txt也是整齐的

2024年3月13日: v1.7.0版本: 1.全面修改yaml一键训练参数(或许能实现训练过程中的热修改) 2.有心做yaml汉化但是大分类上要抛弃英语,具体的key又必须是英语。总之不能双语共存。 3.毕竟我其他地方全都是双语显示,希望大家学熟练之后能够得心应手的修改yaml,否则只能我或者朋友做个UI了。

2024年2月28日: v1.6.2版本: 1.修改训练bat的路径错误

2024年2月27日: v1.6.1版本: 1.汉化了2个合成器。其中原版的合成器用了猫之汉化的图片 2.SAEHD支持两种合成器

2024年2月26日: v1.6.0版本: 1.修改一些bat内容的错误,并增加一些文字介绍。 2.简化与合并—[ 模型 训练 —— Train Models ]—的功能 比如AMP不再区分SRC-SRC 以免误导新人,本质上只是修改bat里的路径罢了。 3.自动读写配置文件(一键开始训练),合并到常规训练,用询问的方式取代等待2秒。 4.确定了A卡能完整使用ME和SAEHD的训练。 我应该是全网第一个做多合一的版本(3种显卡版本x2种模型架构,附RG) 其中ME分支的A卡训练我也是通过改代码的方式。不然还可以尝试下载一个接口插件。 5.温馨提示:强烈推荐cc-aug的色彩迁移模式,效果非常好!但是这个功能不能用RG优化,只能先切换到DX12(哪怕你是N卡)

2024年2月5日: v1.5.4版本: 1.修复模型应用的bat菜单伸缩bug 2.使用SAEHD合成人脸bat的时候call正确的环境 3.导出dfm的bat也链接到对应的环境,改正模型架构名

2024年2月1日: v1.5.2版本:注意了!本次虽然改动很大,但没有给大版本号(主要是修复,不是新功能) 这次是补丁不是完整包!请覆盖到1.5.0版本! 1.ME和SAEHD模型训练全面支持A卡(之前比较仓促,今天积极检查和迁移算法) 备注:ME的A卡训练仍需测试,不报错是第一步。 它的眼嘴训练暂时无效。需要有人协助测试!

2024年1月31日: v1.5.1版本: 1.修复了导出dfm的路径错误(三种模型) 2.修改了ME合成的bat错误

2024年1月30日: v1.5.0版本: 1.环境改动,Landmarks 自动识错应该不报错了 2.终于解决了遗留了很久的问题!就是模型改名的时候报错原因居然是... 我已经做了处理,在提示错误原因的同时,也让脚本继续执行,而不是终止。 3.下一个版本应该会简化预训练的可选参数 4.下个版本想办法明确的提示OOM是显存或虚拟内存不足,并且给出建议提示。跳出好几页的代码 对新手不友好。

2024年1月29日: v1.4.2版本: 1.预训练继续解锁一些参数限制,比如说RW(随机扭曲),禁用一些参数 2.粗心大意发现FP16没有开放完全,漏了个地方已补。 3.下一个版本:基于if self.is_first_run() 看看要搞点什么引导 5.提醒:如果是A卡用户,用了切换环境后,也许只能使用SAEHD训练,不能使用ME,有A卡用户请私聊我交流。

2024年1月28日:还有点问题,暂时不发了,等1.4.2一起解决 v1.4.1版本: 1.想挽救一下“预训练”流程,大家都不用,为何不把这一项删掉? 2.按照官方默认的预训练转正时,不再强制清除inter和迭代数,而是询问用户。 3.开放了FP16,有没有勇士想试试?记得输入“?”看该参数说明 4.详细解释了 -udtc 每个参数的作用,详情请在训练控制台输入“?” 5.由于重新开放了FP16,所以gan不会报错了。但是ME版的gan据说只能选择1个GPU序号。 - Landmarks自动识错 的bat里面路径写错了。已改

2024年1月25日: v1.4.0版本: 1.重大更新!N卡支持RG优化!小显存可以跑大一点的模型,或者增加BS上限 fp16仍然禁用,它是牺牲效果换取速度,令人无语。开发组伙伴想研究混合精度 2.ME和 DFL 两个框架都支持N卡RG,而A卡不支持,试过了 DFL之前为了大家统一能用,是用DX12版本,所以N卡效率有折扣, 现在已经剥离开了,在训练时通过数字1和2来选择驱动类型! 这次的整合包结合了12个dfl版本合一。但是安装包的体积无明显增大。 (包括原版、ME,叠加是否RG,再乘以20系30系和A卡三种安装包) (ME_A卡版本可能会在RG的时候出错,请联系我,毕竟A卡用户太少了) 3.内置了Landmarks自动识错、aligned合并工具,位置在bat的 第8类:——[ 其他 测试 —— Extra Function ]—— 下面 4.由于fp16选项缺失导致开gan报错,忘记修复了。解决方法请看评论区置顶

2024年1月18日:抱歉!消失的一周每天外出 v1.3.2版本: 1.上次1.3版的SAEHD还不是完全的原生,这次是了 2.对一些bat进行纠错,增加了ME模型的合成和导出 3.修复一个未知错误:模型改名报错(检查了一整天源码没问题,怀疑是pyc缓存的问题), 最后是通过回滚版本解决的 4.预训练集挪到了workspace因为经常要和aligned文件夹交换 5. xseg模型在workspace也有独立的目录了。不想跟脸模型混在一起 6.已经在研究如何极致压缩训练集了。目前的src保存于恢复数据非常积累,将来可以利用它! 7.已经顺藤摸瓜RO优化、eye模型、AVATAR模型、多GPU(超过3卡)训练。也是费了些时间收集,源码都拿到了

2024年1月11日: v1.3.0版本: 1.解决了原版SAEHD嫁接的BUG 2.由于DFL到ME容易升版不易降版,对于模型名称做了区分,免得误操作。 SAEHD-ME 简称SAEME模型或ME模型! 3.增加一个模型转换bat,目前只能从原版升ME

2024年1月10日: v1.2.3失败版本(仅记录): 1.植入了原版DFL模型,但是出了点问题 2.明天继续,主要报错是EYE_MOUTH 3.下一个版本可能会把ME版的SAEHD改名为SAEME避免随意转换 4.下下版本增加原版和ME的转换bat

2024年1月9日: v1.2.2版本: 1.支持A卡,并附带一个切换显卡的bat 2.从原版升级时ada锁死 3.创建模型后,禁用ada选项(如同三围不可改) 4.全面取消fp16的选择 5.保留原生环境(基于DX12版本)并补充了jsonschema和attr 6.初始化的时候提供选项:可去除佛像和猫 7.从1.2.1版本开始,就不是补丁,而是完整的整合包了 备注:10系、20系、30系N卡;DX12 都集成到同一个压缩包了

2024年1月7日: 多功能启动UI: DFL-MVE 神农汉化版多功能启动UI-【DFL】软件下载

2024年1月5日: v1.1.1版本: 1.“导出loss”的bat指向的环境改为python3.9 2.python3.6.8原生环境补充attr依赖

2024年1月4日 v1.1.0版本: 1.更改欢迎界面加两只猫 2.5个bat文件修改错误的预训练路径“pretrain_Celeb” 3.loss导出(让大家都知道总好过只有少数人知道) 4.再次更新tensorflow和cuda、cudnn(老显卡并没有提速) 5.python368原环境已补充了jsonschema 6.增加了免责声明

2023年12月29日 v1.0.0版本: 用法:覆盖到原版的安装目录 介绍:原作者是MachineEditor组织的Cioscos、seranus、Payuyi、AnkurSaini07 (顺便一提,keaidelaohu 并没有参加Me的开发,只是复制了源码,改作者名不注明出处、并且加密。违反GPL3.0开源协议) 对了,其实在GitHub通过【 deepfacelab】关键词能搜出来的结果只有千分之一。而你们搜出来的很可能是不讲武德的产物! 因为遵循规则的fork项目你们是不懂得搜的,比如MachineEditor。 搜索关键词【deepfacelab fork:true】只有这样才能找到好东西! MVE功能:新增参数(包括但不限于) [n] Use fp16 ( y/n ?:help ) :这个直接不要开,模型可能会崩掉 [n] Eyes priority ( y/n ?:help ) :单独的眼睛训练 [n] Mouth priority ( y/n ?:help ) :单独的嘴巴训练 [SSIM] Loss function ( SSIM/MS-SSIM/MS-SSIM L1 ?:help ) :这个好像是通过人脸相似度算法来计算loss的,自己搜索术语吧,保持默认就好。 [5e-05] Learning rate ( 0.0 .. 1.0 ?:help ) :学习率一般不去动它,你也可以手动的控制学习率下降,比如我在loss到0.25的时候改为3e-05 [n] Enable random downsample of samples ( y/n ?:help ) :跟随机扭曲同理,增强泛化性:随机降低分辨率 [n] Enable random noise added to samples ( y/n ?:help ) :跟随机扭曲同理,增强泛化性:随机噪点图 [n] Enable random blur of samples ( y/n ?:help ) :跟随机扭曲同理,增强泛化性:随机模糊图 [n] Enable random jpeg compression of samples ( y/n ?:help ) :跟随机扭曲同理,增强泛化性:随机压缩图片质量 [none] Enable random shadows and highlights of samples :比较高级的随机,增强泛化性:随机模拟光影训练 新增的光影色彩学习算法:"fs-aug", "cc-aug" 本人的工作量: 1.汉化 2.升级python3.68至3.9.18 3.升级tensorflow-gpu2.6.0(或2.4.0)至tensorflow-gpu2.10.0 4.做了主目录下的动态bat交互脚本 链接已经免费放在最上方,灵石只是自愿打赏!

未来版本前瞻: 1、2、3、8、9.已完成 4.先做好训练的各阶段预设yaml一键训练,将来再做成全自动托管 6.极致压缩PAK文件 7.新增模型“神农架构V1.0”

|